Quand le jugement de l’IA dépasse celui du thérapeute

Paternalisme 2.0 et atrophie cognitive dans les soins

Il y a une scène que j’ai vécue plusieurs fois ces derniers mois.

Un·e collègue, enthousiaste, me montre une application boostée à l'IA flambant neuve :

« Regarde, l’IA a tout enregistré. Voilà la retranscription complète de l’anamnèse avec mon patient. »

Récemment, j'ai d'ailleurs assisté au webinaire de Flavio Bonnet qui faisait la promotion de Heidi app pour saisir à quel point quelque chose est en train de basculer...

La démonstration est impressionnante : l’IA enregistre l’anamnèse, la restructure, résume les points clés et permet d'envoyer facilement un courrier à un médecin.

Puis, avec une aisance presque déroutante, elle propose un diagnostic et un plan de traitement.

Il s'agit d'une véritable avancée technique dans notre pratique.

Mais si l’on observe les choses attentivement, une question plus profonde émerge :

Que reste-t-il de notre jugement quand une application peut penser à notre place ?

I. Les bénéfices : l’IA corrige nos limites (et nous soulage de nous-mêmes)

Commençons par ce qui est évident : oui, l’IA réduit les erreurs humaines.

Fatigue, biais cognitifs, charge mentale, manque d’informations…

Le raisonnement clinique est un travail humain, donc imparfait.

Heidi app et d’autres outils du même type permettent :

- d'éviter d’oublier un détail important

- de repérer des tableaux atypiques

- de renforcer la vigilance diagnostique

À cet endroit, le leitmotiv des sociétés qui développent les IA est le suivant : étendre certaines de nos capacités sans pour autant les remplacer.

Mais c’est précisément ici que le glissement devient insidieux...

II. Un glissement insidieux : de l’assistance à la délégation

Lorsqu’une IA commence à proposer un diagnostic, la dynamique change de nature.

On ne l’utilise plus seulement pour collecter des données mais pour penser.

On ne la consulte plus pour vérifier un détail, mais pour décider dans des contextes d'incertitude.

Et l’habitude s’installe vite.

Éric Sadin décrit ce phénomène comme "la délégation de notre capacité de jugement".

Nous nous déchargeons peu à peu de notre capacité de raisonner parce qu’une entité technique semble plus à même de décider pour nous.

C’est le même mouvement que Neil Postman anticipait lorsqu’il parlait de technopoly : une société où les institutions humaines s’effacent devant l’autorité des systèmes techniques.

Bien entendu, les thérapeutes ne cherchent pas à abaisser leurs compétences.

Ils cherchent plutôt à diminuer l’incertitude.

Et l’IA promet précisément cela : un monde moins flou, moins ambigu, moins exigeant cognitivement.

Mais c'est justement dans cette promesse là que se niche le risque.

III. Un nouveau paternalisme : l’IA une Pythie moderne ?

Dans le modèle biomédical classique, le paternalisme reposait sur une hiérarchie simple :

Nous voilà aujourd’hui face à un paternalisme 2.0 :

Le risque est clair :

- Perte du libre-arbitre du patient

Mais également :

- Perte du libre-arbitre du soignant

Et ce déplacement n’a rien de neuf dans l’histoire humaine.

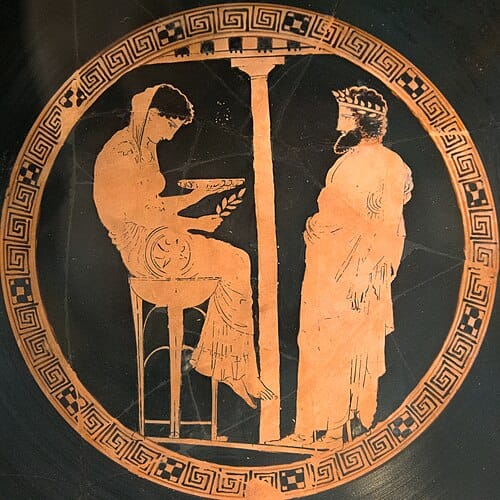

Déjà dans la Grèce antique, les cités-États se rendaient à Delphes pour consulter la Pythie, persuadées que l'oracle leur permettrait de recevoir les paroles des Dieux (Apollon dans ce cas là).

La Pythie délivrait des réponses censées éclairer leurs prise de décisions.

On y venait donc pour diminuer l’incertitude, exactement comme aujourd’hui nous consultons l’IA pour réduire l’ambiguïté clinique.

Pour continuer le parallèle avec l'IA, je voudrais vous relater un cas tristement célèbre : celui de Crésus, roi de Lydie au VIème siècle avant notre ère.

Inquiet de l’expansion des Perses, il consulte l’oracle qui lui dit :

« Si Crésus traverse le fleuve Halys, un grand empire s’effondrera. »

Mais cette prophétie reste énigmatique et laisse entière la question de quel empire sera détruit : celui de l’ennemi ou… son propre royaume.

Crésus y voit une promesse de victoire et attaque donc.

Et c’est son propre empire qui s’effondre.

Hérodote raconte que Crésus, furieux, accusa la Pythie de tromperie.

Les prêtres rétorquèrent que l’oracle avait dit la vérité, seulement c’est lui qui avait mal compris.

(Pas mal pour s'en sortir habilement)

Cette analogie me paraît fort à propos concernant nos questionnements actuels :

La puissance d’une autorité extérieure ne réside jamais seulement dans ce qu’elle dit, mais dans la place que nous lui donnons.

La Pythie entrait "en transe" non pas grâce à une illumination divine… mais probablement à cause de vapeurs s’échappant d’une faille géologique juste sous le temple d’Apollon.

Plutarque (qui fut prêtre à Delphes) évoquait déjà “une odeur agréable, comme des souffles parfumés” dans Sur la disparition des oracles.

Et en 2002, une équipe de géologues a confirmé l’hypothèse : une faille sous le temple libérait de l'éthylène capable de plonger n’importe qui dans un "état second".

Autrement dit : avant que les Grecs ne reçoivent la parole magique, la Pythie recevait surtout… des vapeurs toxiques.

Avec l’IA, nous rejouons la scène de Delphes : cette entité est présentée comme plus "sachante" que nous, plus lucide, moins faillible.

Or, comme l’oracle, l’IA n’est pas neutre.

Ses suggestions ne sont pas des révélations : ce sont des productions statistiques.

Des constructions dont l’apparente clarté peut masquer les ambiguïtés, les biais ou même pire : le faux.

(On parle d'ailleurs d'hallucinations concernant les IA... Tiens, tiens comme la Pythie shootée à l'éthylène 😏)

Pour rappel, une IA, ou plutôt un LLM pour les connaisseurs, ne dit pas le vrai mais le vraisemblable... Ce qui est très différent !

Sachant cela, le danger n’est donc pas tant que l’IA se trompe.

Le danger est que nous perdions la capacité de douter d’elle.

Car c’est exactement ainsi que Crésus a perdu son empire.

IV. L’atrophie cognitive : ce qui se perd quand on ne pense plus

Déléguer un acte technique, c’est une chose.

Déléguer un acte de jugement, c’est tout autre chose.

Car le raisonnement clinique n’est pas un protocole : c’est un savoir-faire qui ne tient que tant qu’il est exercé.

Bernard Stiegler l’a montré : externaliser une fonction psychique conduit tôt ou tard à une perte d’exercice de cette fonction.

Il parle même de "prolétarisation cognitive" : on n’oublie pas seulement quoi penser, on oublie aussi comment penser.

À force de vérifier auprès de l’IA, de s’y aligner, puis de la suivre par automatisme, le thérapeute risque de devenir un exécutant.

Non pas par obéissance aveugle mais par désactivation progressive de son propre jugement.

V. Ce qui restera : un espace que l’IA ne peut occuper

Si l’IA devient peu à peu notre nouvelle Pythie, il existe pourtant un domaine dans lequel elle ne peut pas encore prendre notre place.

Un territoire qui résiste, non par tradition, mais par structure même : la communication thérapeutique.

Pas la communication comme transmission d’informations.

La communication comme interaction.

Comme capacité à répondre, ici et maintenant, à ce que vit un être humain.

C’est une compétence du direct.

Et c’est précisément pour cela qu’elle ne se délègue pas.

Lorsque tu dois rassurer un patient, l’aider à reformuler son vécu ou encore répondre à une inquiétude qui surgie pendant la séance, tu ne peux pas dire :

« Attendez, je consulte ce que ChatGPT vous dirait… »

Puis lire la phrase à voix haute, avec l’intonation approximative d’un porte-parole de l’algorithme...

Parce que ça ne fonctionne pas.

Pas dans le réel.

Pas dans une interaction où l’autre ne réagit pas seulement au contenu de ce que tu dis, mais à la manière dont tu le dis, au moment où tu le dis, en fonction de ce que tu as perçu (ou manqué) dans son visage, son attitude ou même sa voix.

Le soin n’est pas efficace seulement parce qu’on transmet une information correcte.

Le soin opère parce qu’il est authentiquement relationnel.

Une réponse donnée 10 secondes trop tard perd son impact.

Une phrase dite sans voir la micro-hésitation sur le visage du patient rate son objectif.

Un silence que l’on ne sait pas assumer ferme une porte au lieu de l’ouvrir.

C’est dans cette compréhension fine que se joue la dimension thérapeutique de la communication.

Et aucune IA, pour l’instant, ne peut être présente à ce niveau de granularité.

Alors oui, peut-être qu’un jour, nous aurons une puce implantée dans le cerveau qui soufflera en temps réel ce qu’il faudrait dire (Merci Elon 😅).

Mais nous n’en sommes pas là.

Et même dans cet horizon lointain, rien ne garantit que la présence humaine, celle qui sent, qui ajuste, qui accompagne, puisse être substituée.

La communication thérapeutique reste donc ce dernier bastion (non pas par nostalgie d’un monde pré-technologique) mais parce que c’est l’un des rares espaces où le soin se réalise encore entre humains exclusivement.

Parce qu’une interaction humaine et authentique ne se délègue pas.

Et parce qu’aussi longtemps que le soin sera une rencontre, il restera un espace où l’IA ne pourra pas entrer à notre place.

Merci de m'avoir lu.

P.S : ça tombe bien, je forme les thérapeutes à devenir meilleur en communication thérapeutique !

Comment ça, je ne peux pas éclipser ma conclusion aussi poétique que percutante sur l'autel de mon auto-promo ? 😜

👉🏻 Clique ici si tu veux en savoir plus

Mes formations pour aller plus loin :